Cada vez que le preguntas algo a ChatGPT, la IA se bebe una pequeña porción de agua real. No es una metáfora, literalmente es así. Los servidores se calientan, necesitan enfriarse y, en muchos casos, ese enfriamiento consume agua que termina evaporándose en el aire. Todo eso ocurre en algún centro de datos de Texas o Arizona mientras tú esperas la respuesta en pantalla.

Y mientras ese ciclo se repetía millones de veces al día, Apple llevaba más de un año con la solución perfecta en el bolsillo. Si la IA funciona internamente en tu iPhone, no hay servidor que enfriar. Pero ese escudo puede tambalearse con la llegada de Gemini a la nueva Siri y al futuro de Apple Intelligence.

500 mililitros por cada 20 preguntas

Según el estudio de la Universidad de California en Riverside, ChatGPT consume aproximadamente 500 mililitros de agua por cada 20 a 50 preguntas respondidas, contando tanto el agua directa de refrigeración como la indirecta ligada a la generación eléctrica. Un sorbo aquí, un sorbo allá, nada alarmante a escala individual, pero, sumado, ya es otra historia.

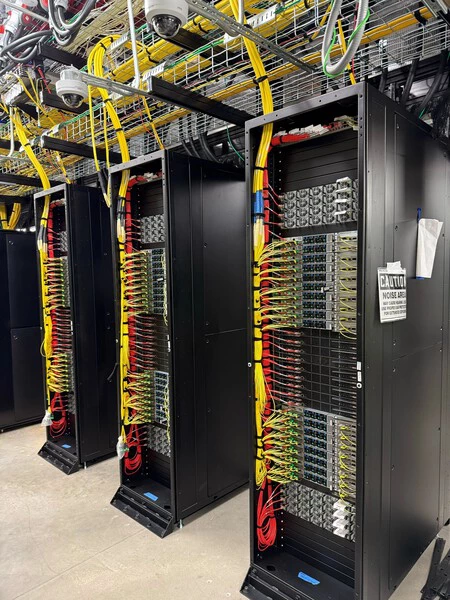

Uno de los miles de servidores de OpenAI en Texas

Uno de los miles de servidores de OpenAI en Texas

Y no hablamos solo de ChatGPT, cualquier IA conversacional que corra en servidores remotos, ya sea Gemini, Grok o Claude, arrastra el mismo problema por el simple hecho de necesitar refrigeración.

Solo los centros de datos que alimentan sistemas de IA en Estados Unidos consumieron alrededor de 64.000 millones de litros de agua en 2023 y estamos ya en 2026, con un uso de la IA mucho más intenso.

Un análisis de Bloomberg revela que aproximadamente dos tercios de los nuevos centros de datos de IA en EE. UU. desde 2022 se están ubicando en zonas con alto estrés hídrico, lugares donde el agua ya era un recurso tensionado mucho antes de que llegara ningún servidor. Texas, Arizona, el oeste americano: los mismos sitios donde más llueve silicio son donde menos llueve de verdad.

Uno de los centros de datos de OpenAI en Texas

Uno de los centros de datos de OpenAI en Texas

Y eso es solo el consumo en producción. Entrenar los modelos es otra historia. Solo entrenar GPT-3 en los centros de datos de Microsoft implicó del orden de 700.000 litros de agua. Y eso contando un único entrenamiento, sin los reentrenamientos posteriores ni las versiones mejoradas que quedaron por el camino.

Apple tenía la respuesta correcta

Mientras todo esto ocurría, Apple construía en silencio la arquitectura más sostenible de la industria. No por razones puramente medioambientales, sino por privacidad. Aun así, el efecto secundario era el mismo: si el modelo de IA funciona en el procesador de tu iPhone, no hay petición que salga al exterior, no hay servidor remoto que procese nada ni agua que evaporar. Es el equivalente energético de cocinar en casa en lugar de pedir a un restaurante con cocina industrial al otro lado del mundo.

Incluso cuando la tarea requería más potencia y saltaba a Private Cloud Compute, Apple lo había diseñado para minimizar el impacto. Sus servidores son propios, están bajo sus estándares de eficiencia y el procesamiento se limita estrictamente a lo necesario: solo una parte de la petición llega, se procesa y se olvida. Era una solución que, de paso, le daba a Apple un argumento que ningún competidor podía esgrimir: que su IA era la menos contaminante por diseño, no por marketing.

Entonces llegó Gemini

El problema es que Apple necesitaba que Siri funcionase bien y sus propios modelos no estaban a la altura. Después de casi dos años de retrasos y de unas negociaciones fallidas con Anthropic, Apple terminó en los brazos de Google con una alianza que se confirmó en enero de 2026.

El acuerdo tiene capas, como todo lo que hace Apple. Según la documentación técnica, Google entrega a Apple el modelo base de Gemini, un cerebro en bruto con la capacidad de cálculo de Google pero sin contexto ni instrucciones de comportamiento.

Apple lo postentrena, lo adapta a iOS y lo convierte en su propio Apple Foundation Model. Para las tareas más cotidianas, esa versión destilada de Gemini correría en local, en el propio dispositivo, y hasta ahí el problema del agua no empeora.

Pero hay una segunda parte del acuerdo donde empiezan los problemas: el chatbot conversacional completo de Siri, el que llegará con iOS 27, según las informaciones, funcionaría sobre infraestructura de Google, bajo Google Cloud.

Apple dice una cosa, Google dice otra

Tim Cook, en la presentación de resultados del cuarto trimestre, ofreció algo aparentemente tranquilizador:

Seguiremos ejecutando en el dispositivo y en Private Cloud Compute, manteniendo nuestros estándares de privacidad líderes en la industria al hacerlo.

La palabra clave es "seguiremos", continuidad, los mismos estándares de siempre. Pero, en esa misma semana, directivos de Google dijeron casi palabra por palabra que ellos son el "proveedor de nube preferido" de Apple para desarrollar los nuevos modelos basados en Gemini. Dos versiones, una misma realidad.

El agua vuelve, pero no siempre al mismo sitio

Hay un argumento que conviene matizar antes de cerrar el tema: el agua que evaporan estos centros de datos no desaparece para siempre. El ciclo hidrológico existe, el vapor sube, se condensa y vuelve a caer como lluvia. El problema, es que esa lluvia no cae precisamente donde la cogieron, sino varios cientos de kilómetros más al este, a merced del viento. Y eso importa cuando hablamos de zonas que ya llevan décadas con el grifo casi cerrado.

Dicho esto, sería injusto no reconocer que la industria está reaccionando. Microsoft lleva desde agosto de 2024 diseñando todos sus nuevos centros de datos con un sistema de refrigeración en circuito cerrado que no evapora ni una sola gota. El agua circula entre los chips y los enfriadores sin necesidad de reposición, ahorrando más de 125 millones de litros por instalación y año.

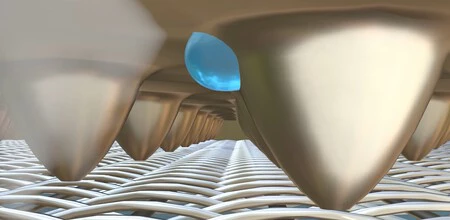

Fase de evaporación

Fase de evaporación

Es, básicamente, el mismo principio que tiene la cámara de vapor del iPhone 17 Pro: unas pocas gotas que se evaporan, se condensan y vuelven a empezar, sin consumir nada.

Fase de condensación

Fase de condensación

Por otro lado, el problema está en que el modelo de IA que menos agua consume es también el menos potente. Apple Intelligence procesa casi todo en el propio dispositivo, sin mandar apenas nada a la nube. Su huella hídrica es mínima comparada con la de ChatGPT o Gemini. Pero a la hora de la verdad, los modelos que arrasan en uso son precisamente los que corren en esos centros de datos sedientos. No porque la gente sea inconsciente, sino porque el salto de calidad pesa más que cualquier dato sobre litros evaporados.

¿Dónde está el límite? Difícil saberlo, y quizás imposible dibujarlo. El progreso tecnológico siempre ha tenido un coste medioambiental que la sociedad ha ido negociando sobre la marcha: primero el vapor, luego el petróleo, ahora el agua y la electricidad. Lo que sí parece claro es que la responsabilidad de gestionar bien ese coste no puede caer solo en el usuario. Son las empresas las que deciden dónde construyen, qué sistema de refrigeración instalan y con qué ritmo lo renuevan. El circuito cerrado de demuestra que hay caminos mejores. La pregunta es cuánto tardan los demás en tomarlo.

En Applesfera | Nuevo iOS 27 - todo lo que creemos saber sobre el futuro sistema operativo para el iPhone

En Applesfera | Nuevo iPhone plegable - Todo lo que creemos saber sobre él

Ver 8 comentarios