Llevamos meses escuchando rumores sobre AirPods con cámara, unas gafas inteligentes y algún tipo de colgante con inteligencia artificial. Son dispositivos que cuesta visualizar por separado y que juntos todavía cuestan más. Pero Mark Gurman los conecta a todos bajo una misma lógica. El hilo que usa para hacerlo no es el hardware, sino algo que Tim Cook dijo en la última llamada de resultados: que Visual Intelligence es una de las funciones más populares de Apple Intelligence y que Apple tiene una "ventaja incuestionable" en IA gracias a sus 2.500 millones de dispositivos activos.

Para Gurman, esas palabras no son relleno. Son la misma señal que Cook lanzó en 2013 cuando empezó a hablar de sensores antes de que existiera el Apple Watch, y la misma que lanzó en 2016 cuando se obsesionó con la realidad aumentada antes de que el Vision Pro fuera siquiera un proyecto conocido. Si el patrón se repite, y Gurman cree que sí, Visual Intelligence es la tecnología sobre la que Apple va a construir su próxima gran categoría de producto.

El problema que tiene Visual Intelligence hoy

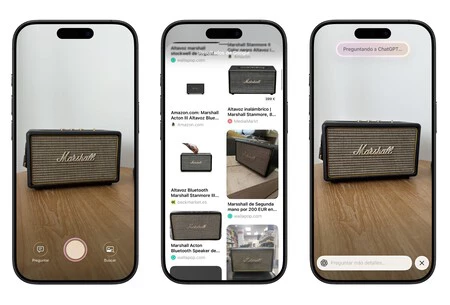

La función ya existe en tres generaciones de iPhone. Apuntas la cámara a algo, un plato de comida, un cartel, un objeto, y el sistema lo analiza y busca información. Funciona, pero tiene una limitación: requiere que saques el teléfono, lo apuntes y esperes. No es inteligencia ambiental, es una acción deliberada. Algo parecido a lo que llevamos años haciendo con Google Lens, solo que con mejor integración en el sistema.

Lo que Gurman dibuja como objetivo es otra cosa. Una IA que vea el mundo de forma continua, sin que tengas que activarla, que entienda el contexto de lo que tienes delante y actúe en consecuencia.

En lugar de decirte "gira a la derecha dentro de 50 metros" te diga "gira a la derecha pasada la farmacia de la esquina.

Que cuando te acerques a algo que tenías pendiente te lo recuerde sin que hayas abierto ninguna app. Para eso necesitas cámaras que estén siempre contigo y siempre mirando, no guardadas en el bolsillo.

Visual Intelligence

Visual Intelligence

Tres dispositivos, una misma apuesta

Según Mark Gurman y sus fuentes dentro de Cupertino, Apple tiene en desarrollo tres formatos de hardware pensados para esto.

- Los AirPods con cámara serían los primeros en llegar, previsiblemente a finales de este año. No se trata de cámaras para hacer fotos, sino de sensores de baja resolución o infrarrojos cuyo único propósito es darle al sistema una vista del entorno.

- Las Apple Glass vendrían después: unas gafas sin pantalla de realidad aumentada, con cámara y audio, en la línea de lo que Meta ha estado haciendo con Ray-Ban. La diferencia, según Gurman, es que mientras Meta usa una sola cámara que alterna entre visión artificial y captura de vídeo, Apple planea lentes dedicadas para cada función.

- Y luego está el autodenominado "pendant". Un dispositivo que se llevaría colgado al cuello o enganchado en la ropa. Aquí la referencia inevitable es el Humane Ai Pin, pero Gurman confía en que ese producto no fracasó por su formato, sino porque era lento, su interfaz no funcionaba y se vendió como sustituto del teléfono. El de Apple sería un complemento del iPhone, no su rival.

El motor todavía no está listo

Visual Intelligence, tal como existe hoy, es básicamente una capa sobre ChatGPT y los sistemas de Google. Apple no tiene todavía un modelo propio de visión artificial desplegado para el usuario. Lo está desarrollando. Hay equipos dedicados, trabajo acumulado del proyecto del Apple Car y del Vision Pro, pero no está en el producto final.

Eso explica por qué todo esto es una historia de medio y largo plazo. Mark Gurman no está diciendo que Apple vaya a presentar un "pendant" o colgante el año que viene. Está diciendo que las piezas se están colocando: el discurso de Tim Cook establece la dirección, el hardware está en desarrollo y el modelo de IA propio que lo tiene que alimentar se está construyendo en paralelo.

La historia de Tim Cook con las grandes categorías de producto siempre ha funcionado igual: primero el discurso, luego el hardware, luego la evolución de ese hardware durante años. Con el Apple Watch tardó más de un año desde las primeras señales hasta el lanzamiento. Con el Vision Pro, casi una década. Con Visual Intelligence, las señales llevan poco tiempo sobre la mesa, pero el desarrollo interno lleva mucho más. Cuando los AirPods con cámara lleguen a una keynote, o cuando Apple enseñe sus primeras gafas, esta conversación habrá explicado ya por qué.

En Applesfera | Nueva Siri: novedades, dispositivos compatibles y todo lo que sabemos sobre ella

En Applesfera | Nuevo iOS 27 - todo lo que creemos saber sobre el futuro sistema operativo para el iPhone

Ver 0 comentarios