El nuevo CEO de Apple lleva 25 años en la compañía y toda su carrera construida sobre el hardware. John Ternus ha tocado prácticamente cada producto importante que Apple ha sacado en ese tiempo: la transición de Intel a Apple Silicon, generaciones enteras de iPhone, iPad, Mac, los AirPods. Es, probablemente, el hombre que mejor conoce lo que Apple fabrica y hacia dónde va lo que fabrica.

Y que el perfil que ha elegido el consejo para liderar Apple en 2026 sea ese, el del hardware, tiene su miga. Porque Apple lleva años encajando críticas por Siri, por los retrasos de Apple Intelligence y por tener que llamar a Google para que le eche una mano con el asistente.

Desde fuera parece que va por detrás en la carrera de la IA. Pero hay otra forma de leer lo que está pasando: que Apple ya tiene el cuerpo construido, y que su apuesta no va es la de tener el mejor modelo de lenguaje, sino de tener el mejor sitio donde ejecutarlo. Y ese sitio es el chip que llevas en el bolsillo.

Apple criticada por su IA, mientras sus productos son los más usados para hacer IA

Hay algo curioso en el relato de que Apple va perdiendo la guerra de la inteligencia artificial. Mientras Siri acumula memes y los retrasos de Apple Intelligence llenan titulares, los desarrolladores de IA trabajan en MacBook.

Las startups de IA montan sus entornos en Mac Studio. Y Perplexity, una de las empresas de IA más interesantes del momento, lanzó este año su producto estrella de agentes (el Personal Computer) sobre un Mac mini M4. No sobre un servidor Linux, no sobre un PC con Windows. Un Mac mini.

Apple no ha ganado la carrera del software de IA, eso es cierto. Pero sus máquinas se han convertido en el campo de trabajo donde esa carrera se disputa. Y es una consecuencia directa de tener el chip adecuado en el momento adecuado.

Lo que lleva años construyéndose

El Neural Engine del A18 Pro (el mismo que el del MacBook Neo) ejecuta 35 billones de operaciones por segundo. El primer chip de Apple con Neural Engine, el A11 de 2017, hacía 600.000 millones. En ocho años, Apple ha multiplicado esa capacidad casi 60 veces, sin que el iPhone haya dejado de caber en un bolsillo ni de aguantar un día con la batería.

Eso es exactamente lo que más importa para la IA en local. Ejecutar un modelo de lenguaje en la nube requiere centros de datos con GPU que consumen cientos de vatios cada una y una infraestructura eléctrica descomunal.

Presentación del chip A11, hace nueve años y ya enfocado a la IA

Presentación del chip A11, hace nueve años y ya enfocado a la IA

Hacerlo en un iPhone consume una fracción de eso. Y Apple lleva construyendo ese músculo desde 2017, antes de que casi nadie hablara de la inteligencia artificial. Cuando el resto de la industria empezó a correr, Apple ya llevaba casi una década en el gimnasio.

La clave no es solo la potencia bruta: es la combinación de rendimiento y consumo. Cualquier empresa puede meter más transistores en un chip si le das espacio y corriente eléctrica. Hacerlo dentro de un teléfono, con una batería de bolsillo, manteniendo una temperatura razonable, es un problema de ingeniería completamente distinto. Y Apple lleva más tiempo resolviéndolo que nadie. Y hablamos de teléfonos, pero lo mismo se puede aplicar al Mac con sus potentes chip M.

Entonces, ¿por qué Google?

Si el chip de Apple es tan bueno, ¿por qué la nueva Siri necesita a Google Gemini para funcionar? Es la pregunta obvia, y la respuesta es más tranquilizadora de lo que parece.

Un chip potente no escribe solo los modelos de lenguaje que lo aprovechan. Entrenar un LLM competitivo requiere años de trabajo, miles de ingenieros especializados y una cantidad de datos que Apple, por su propio modelo de negocio centrado en la privacidad, no tiene de la misma forma que Google o OpenAI. Esa es la parte que falta, y Apple ha decidido (de momento) comprarla en lugar de construirla desde cero.

Es un problema a futuro, sí. Pero es un problema de software, y el software se puede iterar, mejorar, cambiar de proveedor o desarrollar internamente con tiempo. Lo que no se improvisa en doce meses es una arquitectura de chip con casi una década de ventaja. Apple tiene un problema con Siri. No tiene un problema con la potencia para crear IA.

El tiempo juega a favor de quien tiene la plataforma

Hay 230 millones de iPhone que salen de fábrica cada año, cada uno con un Neural Engine. No hay ningún competidor con ese volumen de hardware propio en manos de usuarios. Eso significa que cuando la IA en local madure, cuando los modelos sean suficientemente ligeros y eficientes para correr completamente en dispositivo, Apple tendrá la base instalada más grande del mundo para ejecutarlos. Y las empresas querrán que sea así. Porque mantener tantos y tantos servidores llegarán un punto en el que sea insostenible.

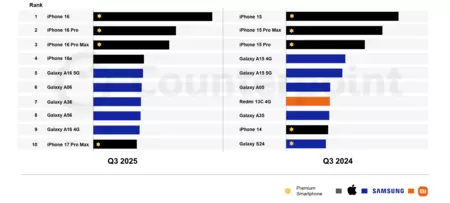

Con o sin IA, los iPhone son los modelos de smartphone más vendidos en 2024 y 2025

Con o sin IA, los iPhone son los modelos de smartphone más vendidos en 2024 y 2025

Ahora estamos en una fase de expansión de la IA. Pero llegará un punto en el que se asiente, y se optimicé. Será entonces cuando tener un buen rendimiento en el dispositivo será diferencial. Y Apple estará ahí. Lleva estando desde hace diez años con los primeros Neural Engine.

Google tiene Pixel, que vende alrededor de 10 millones de unidades al año. Es un producto excelente, pero es una escala diferente. El resto de fabricantes Android comparten la arquitectura de Qualcomm, sin el control vertical que da diseñar tu propio chip. Apple tiene ese control desde 2020 con Apple Silicon en Mac, y desde mucho antes en iPhone.

John Ternus lo sabe mejor que nadie. Ha estado en cada decisión de arquitectura de los últimos diez años. Y ahora le toca también decidir qué se hace con todo eso. El hardware está. El software llegará. La pregunta es cuándo, y con qué.

La apuesta que no hace ruido

Apple no está intentando competir con Google, OpenAI o Anthropic en el juego de los grandes modelos. No va a presentarse a ese concurso, y probablemente no le interesa. Su apuesta es diferente: que el futuro de la IA no pasa solo por quién tiene el modelo más grande, sino por quién tiene la mejor plataforma para ejecutarlo cerca del usuario. Sin nube, sin latencia, sin mandar tus datos a un servidor en Virginia.

Y resulta que el resto de la industria empieza a llegar a la misma conclusión. OpenAI proyecta pérdidas de 14.000 millones de dólares en 2026, con un gasto en infraestructura de centros de datos que no para de crecer. Su respuesta ha sido fichar a Jony Ive para diseñar su propio hardware y salir al mercado con un dispositivo físico. La empresa que popularizó la IA en la nube está buscando, ahora, tener su propio dispositivo en tus manos. Apple lleva haciendo eso desde 2017

Que Tim Cook haya puesto al frente de esa apuesta al hombre que más sabe de lo que hay dentro de los productos de Apple dice bastante sobre dónde cree la compañía que está el partido. No en los laboratorios de modelos, sino en los chips, en los dispositivos, en la plataforma.

¿Saldrá bien? Eso depende de que el software acompañe, y ahí Apple todavía tiene deberes pendientes. Pero la infraestructura para intentarlo ya existe, lleva años construyéndose y está en el bolsillo de 230 millones de personas. Pocas empresas en el mundo pueden decir lo mismo.

En Applesfera | Nuevo iOS 27 - todo lo que creemos saber sobre el futuro sistema operativo para el iPhone

En Applesfera | WWDC26: fecha y novedades que esperamos del gran evento de Apple en el que se presentará iOS 27

Ver 0 comentarios